Никаких этических законов для ИИ не существует

_____

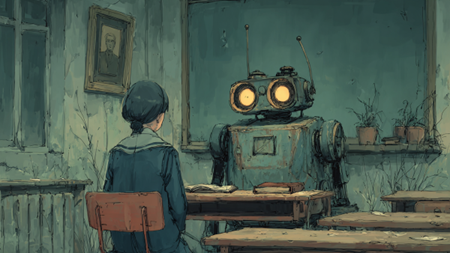

Изображение: ВЗГЛЯД

Я пишу вам из будущего – прямо из подвала. Там, наверху, роботы, управляемые искусственным интеллектом Skynet, добивают остатки сопротивления живых людей под лозунгом «Смерть луддитам». Сейчас догорит свеча, человеческий интернет окончательно отключат, и беспилотные траки «Тесла» разравняют площадки для постройки очередного дата-центра. Я просто пытаюсь предупредить скорбных гуманитариев. Считайте это несвоевременным сарказмом

Все начнется со школы. И даже не тогда, когда школьники будут вместо собственных знаний подсовывать галлюцинации ИИ вместо ответов на экзаменах. А случится это, когда ИИ начнет эти экзамены у школьников принимать. Такие идеи регулярно высказываются. Как это будет выглядеть конкретно.

Автоматизация устных экзаменов: ИИ может принимать устные ответы, анализируя не только содержание, но и поведение экзаменуемого.

Прокторинг (контроль списывания): нейросети контролируют честность, выявляя попытки списать, использование телефона или присутствие посторонних лиц.

Генерация тестовых заданий: ИИ создает разнообразные вопросы, включая сложные, для проверки глубоких знаний.

Оценка знаний: быстрый анализ открытых ответов и эссе, выявление пробелов в знаниях.

Начнем с того, что в таком варианте торпедируется одно из фундаментальных понятий педагогики: экзамен – это интегральная часть воспитательного процесса. И важнейший этап общения педагога и ученика.

Отдавая его автомату, вы превращаете экзамен в допрос с использованием детектора лжи. Учитывая, что детектор лжи не делает заключений и не выносит решений – это делают люди. Последние два пункта – совершенно убойные, так как к тому времени, когда идея реализуется, ИИ будет не только врать в таких важных темах, как история, общество и литература, он уже будет пользоваться плодами многолетнего вранья, собственно, самих ИИ, запущенных в сеть. Уже сейчас каждый хороший узкий специалист в различных секторах сталкивается с проблемой точности информации, верификации и т.д. Потому что половину ответов ИИ придумывает сам. Будучи пойманным на вранье, он льстиво извиняется и говорит: «Да, вы правы,дело на самом деле обстоит так-то и так-то». И, скорее всего, опять даст только часть информации.

Если вы еще находитесь в пузыре торговцев услугами ИИ, то вас, наверное, царапнуло слово «автоматизация». Но по классическому определению дисциплины «Автоматизированные системы» – это штука,преобразующая входные сигналы (данные датчиков) в выходные действия (движения исполнительных механизмов). А как это сконструировано технически, уже никого не волнует.

Предоставляя право экзаменовать ваших детей автомату, вы превращаете необходимый школьный этап в пытку. А если учесть, что каждое новое поколение совершенно очевидно нежней предыдущего, и все хуже и хуже умеет держать психологический удар – это будет ад. Нам вполне достаточно того, как дети не справляются даже с давлением ЕГЭ.

Впрочем, сочетание ИИ и школы уже сегодня выглядит достаточно кринжово. Есть одна страна, которая полностью профукала цифровизацию, но начальство велит соответствовать. В Германии рабочую тетрадь для инклюзивных школ сгенерировали в ИИ.

Вот какие картинки предстали перед пользователями учебного пособия по математике: неестественно искаженные физиономии людей, ведущие в никуда двери, канатоходец без каната. А дальше – сплошной Иероним Босх: слоненок без хобота, человек с шестью глазами, учитель с шестью пальцами на одной руке и голова ребенка, лежащая на полке.

Вся эта неземная красота сопровождается невероятным количеством арифметических ошибок в заданиях. Автор (ка) потратила на создание этой тетради год (прописью – 365 дней). Хотелось бы поерничать: «и так у них все», но проблема в том, что не только у «них» так. Так – у всех.

Потому что ИИ создается не для очарованных странников, которые думают, что пишут с помощью искусственных мозгов песенки, рисуют картинки и романы. Это все – просто этапы обучения, и объект обучения тут – не вы. Вы – вовсе наоборот – просто халявный тренер силиконового монстра. Помните прекрасную историю – когда пользователи игры «Покемоны» собрали невероятную базу данных с привязкой к местности просто во время игры? Геоданные, которые не могли собрать гугломобили с камерами. Очень полезные данные для планирования операций и боев в условиях мегаполисов. Естественно, данные все уже проданы нужным компаниям.

Текст от главы «Палантира» – буквально манифест Бигтеха – не оставляет сомнений в том, зачем все это делается. Это пример беспримесного нового фашизма. Технофашизма.

«Вопрос не в том, будет ли создано оружие на основе ИИ, а в том, кто его создаст и с какой целью. Наши противники не станут делать паузу ради театральных дискуссий о целесообразности разработки технологий, имеющих критическое значение для армии и национальной безопасности. Они будут действовать», – говорится в тексте.

С этого момента вообще становится ясно, кто и зачем создает все более мощный ИИ. И старательно внедряет его во все уголки человеческой деятельности на манер игры «Поймай покемона». Конечно, мы смотрим, как китайские роботы участвуют в марафоне, кто-то падает и разлетается на куски, и все переживают за железяку, как за своего. Роботы встречают гостей на конференциях, выполняют роль официантов. Но это все – пыль в глаза на манер ИИ-шечных однотипных мультиков, которые не клепает нынче только ленивый. Потому, что робо-актуалочка теперь выглядит так.

Наш противник активно внедряет наземные роботизированные комплексы (НРК) для выполнения боевых и логистических задач, стремясь в самом близком будущем заменить до 30% личного состава на передовой. Роботы используются для разведки, эвакуации раненых, разминирования, логистики, а также для штурма позиций, что снижает риски для солдат. Уже в этом году планируется использовать до 25 000 наземных роботов для замены пехоты в самых сложных районах фронта.

Мы тоже движемся в этом направлении, потому что нам не оставляют выбора. Айзек Азимов в рассказе «Хоровод» предпринял наиболее известную сейчас попытку создания этических правил для роботов. По замыслу автора, три закона должны наложить этический оттенок на поведение машины.

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

И все тогдашние авторы, нацеленные в будущее и его описание – согласились. Фантасты-романтики Америки. Сколько лет они нам эту лапшу вешали на уши. Описывали, кстати, что будет, если роботы станут эти законы нарушать. Спойлер винтажной литературы: плохо будет.

И вдруг оказывается, что никаких этических законов нет, романтические бредни первых идеологов и футуристов роботостроения выброшены на помойку. Индустрия начинает строить роботов, которые созданы именно с целью нанести вред человеку и даже его убить насмерть. И это сегодняшний день.

Но настоящим черным днем человечества станет тот день, когда подразделениями роботов-солдат начнет управлять другой робот – то есть ИИ. Полностью лишенный таких качеств, как совесть, интеллект, не имеющий представления о добре и зле. То есть – примерно тот самый «Скайнет», о котором нам рассказывал Джеймс Камерон в «Терминаторе».

Помните историю о том советском офицере, который засомневался, что угроза ракетной атаки со стороны американцев – это не сбой системы. И не нажал на кнопку. В тот раз Апокалипсис не состоялся, потому что это был реальный сбой системы. В аналогичной ситуации искусственный интеллект, не обремененный сомнениями и совестью, просто нанесет удар, и как можно быстрее.

И если кто-то выживет, то даже обвинить в уничтожении 90 процентов человечества будет некого. Не будет больше Гитлера, на которого можно все свалить. Ну, разве что тех парнишек, которые очень хотели заработать, и строили свои ИИ, избегая простых человеческих понятий и качеств, потому что сами не обладали ими напрочь. Можно, конечно, выкатить претензию этому умнику из «Палантира», который рассказал, что бога больше нет, души нет, человечности нет и поэтому все позволено. Кстати, о чем предупреждал естественный интеллект модели FM Dostoyevsky.

Впрочем, до ядерной войны нас могут довести и вполне определенные, живые пока, люди, не дожидаясь «Скайнета». Но роботы уже сейчас могут приступить к уничтожению пленных, а также гражданского населения на разведанных искусственным интеллектом участках территорий, и им никто не помешает. Практика малых дел, как она есть.

Понимаю, что я сейчас выгляжу, как луддит.

Но тут существует историческая подмена и шельмование. Именно нерегулируемое развитие средств производства (сначала в ткацком деле) тогда, в XIX веке, во время промышленной революции, привело к еще большему закабалению рабочего класса. А в наши вегетарианские времена, например, вызвало уничтожение национальных индустрий на целых континентах, заваленных секонд-хэнд тряпьем из «цивилизованных стран» – пример Африканского континента вам в ленту. Так что луддиты in the end of the day были не так уж неправы.

Игорь Мальцев, ВЗГЛЯД

- 125 просмотров